怎么在Python中使用正则表达式实现一个爬虫功能

这篇文章给大家介绍怎么在Python中使用正则表达式实现一个爬虫功能,内容非常详细,感兴趣的小伙伴们可以参考借鉴,希望对大家能有所帮助。

第一步:获取数据

1. 按照我们之前的用法,我们需要一个加载页面的方法。

这里我们统一定义一个类,将url请求作为一个成员方法处理。

我们创建了一个文件,叫duanzi_spider.py

然后定义一个Spider类,并且添加一个加载页面的成员方法。

importurllib2

classSpider:

"""

内涵段子爬虫类

"""

defloadPage(self,page):

"""

@brief定义一个url请求网页的方法

@parampage需要请求的第几页

@returns返回的页面url

"""

url="http://www.neihan8.com/article/list_5_"+str(page)+".html"

#user-Agent头

user_agent="Mozilla/5.0(compatible;MSIE9.0;WindowsNT6.1;Trident/5.0"

headers={"User-Agent":user_agent}

req=urllib2.Request(url,headers=headers)

response=urllib2.urlopen(req)

printhtml以上的loadPage的实现思想想必大家都应该熟悉了,需要注意定义python类的成员方法需要额外添加一个参数self.

2.写main函数测试一个loadPage方法

if__name__=="__main__":

"""

=====================

内涵段子小爬虫

=====================

"""

print("请按下回车开始")

raw_input()

#定义一个Spider对象

mySpider=Spider()

mySpider.loadPage(1)程序正常执行的话,我们会在皮姆上打印了内涵段子第一页的全部html代码。但是我们发现,html中的中文部分显示的可能是乱码。

那么我们需要简单的将得到的网页源代码处理一下:

defloadPage(self,page):

"""

@bridf定义一个url请求网页的方法

@parampage需要请求的第几页

@returns返回的页面html

"""

url="http://www.neihan8.com/article/list_5_"+str(page)+".html"

#user-agent头

user-agent="Mozilla/5.0(compatible;MSIE9.0;WindowsNT6.1;Trident/5.0"

headers={"User-Agent":user-agent}

req=urllib2.Request(url,headers=headers)

response=urllib2.urlopen(req)

html=response.read()

gbk_html=html.decode("gbk").encode("utf-8")

returngbk_html注意:对于每个网站对中文的编码各自不同,所以html.decode("gbk")的写法并不是通用的,根据网站的编码而异。

第二步:筛选数据

接下来我们已经得到了整个页面的数据。但是,很多内容我们并不关心,所以下一步我们需要筛选数据。如何筛选,就用到了上一节讲述的正则表达式

首先

importre

然后,我们得到的gbk_html中进行筛选匹配。

我们需要一个匹配规则

我们可以打开内涵段子的网页,鼠标点击右键"查看源代码"你会惊奇的发现,我们需要的每个段子的内容都是在一个<div>标签中,而且每个div标签都有一个属性class="f18 mb20"

根据正则表达式,我们可以推算出一个公式是:

<div.*?class="f18 mb20">(.*?)</div>

这个表达式实际上就是匹配到所有div中class="f18 mb20"里面的内容(具体可以看前面介绍)

然后这个正则应用到代码中,我们会得到以下代码:

defloadPage(self,page):

"""

@brief定义一个url请求网页的办法

@parampage需要请求的第几页

@returns返回的页面html

"""

url="http://www.neihan8.com/article/list_5_"+str(page)+".html"

#User-Agent头

user-agent="Mozilla/5.0(compatible;MSIE9.0;WindowsNT6.1;Trident/5.0"

headers={"User-Agent":user-agent}

req=urllib2.Request(url,headers=headers)

response=urllib2.urlopen(req)

html=response.read()

gbk_html=html.decode("gbk").encode("utf-8")

#找到所有的段子内容<divclass="f18mb20"></div>

#re.S如果没有re.S,则是只匹配一行有没有符合规则的字符串,如果没有则匹配下一行重新匹配

#如果加上re.S,则是将所有的字符串按一个整体进行匹配

pattern=re.compile(r'<div.*?class="f18mb20">(.*?)</div>',re.S)

item_list=pattern.findall(gbk_html)

returnitem_list

defprintOnePage(self,item_list,page):

"""

@brief处理得到的段子列表

@paramitem_list得到的段子列表

@parampage处理第几页

"""

print("*********第%d页,爬取完毕...******"%page)

foriteminitem_list:

print("===============")

printite这里需要注意一个是re.S是正则表达式中匹配的一个参数。

如果没有re.S则是只匹配一行有没有符合规则的字符串,如果没有则下一行重新匹配。

如果加上re.S则是将所有的字符串按一个整体进行匹配,findall将匹配到的所有结果封装到一个list中。

如果我们写了一个遍历item_list的一个方法printOnePage()。ok程序写到这,我们再一次执行一下。

pythonduanzi_spider.py

我们第一页的全部段子,不包含其他信息全部的打印了出来.

你会发现段子中有很多<p>,</p>很是不舒服,实际上这个是html的一种段落的标签。

在浏览器上看不出来,但是如果按照文本打印会有<p>出现,那么我们只需要把我们的内容去掉即可。

我们可以如下简单修改一下printOnePage()

defprintOnePage(self,item_list,page):

"""

@brief处理得到的段子列表

@paramitem_list得到的段子列表

@parampage处理第几页

"""

print("******第%d页,爬取完毕*****"%page)

foriteminitem_list:

print("============")

item=item.replace("<p>","").replace("</p>","").replace("<br/>","")

printitem第三步:保存数据

我们可以将所有的段子存放在文件中。比如,我们可以将得到的每个item不是打印出来,而是放在一个叫duanzi.txt的文件中也可以。

defwriteToFile(self,text):

"""

@brief将数据追加写进文件中

@paramtext文件内容

"""

myFile=open("./duanzi.txt","a")#a追加形式打开文件

myFile.write(text)

myFile.write("-------------------------")

myFile.close()然后我们将所有的print的语句改写成writeToFile(), 当前页面的所有段子就存在了本地的duanzi.txt文件中。

defprintOnePage(self,item_list,page):

"""

@brief处理得到的段子列表

@paramitem_list得到的段子列表

@parampage处理第几页

"""

print("***第%d页,爬取完毕****"%page)

foriteminitem_list:

item=item.replace("<p>","").replace("</p>","").replace("<br/>"."")

self.writeToFile(item)第四步:显示数据

接下来我们就通过参数的传递对page进行叠加来遍历内涵段子吧的全部段子内容。

只需要在外层加上一些逻辑处理即可。

defdoWork(self): """ 让爬虫开始工作 """ whileself.enable: try: item_list=self.loadPage(self.page) excepturllib2.URLError,e: printe.reason continue #将得到的段子item_list处理 self.printOnePage(item_list,self.page) self.page+=1 print"按回车继续...." print"输入quit退出" command=raw_input() if(command=="quit"): self.enable=False break

关于怎么在Python中使用正则表达式实现一个爬虫功能就分享到这里了,希望以上内容可以对大家有一定的帮助,可以学到更多知识。如果觉得文章不错,可以把它分享出去让更多的人看到。

推荐阅读

-

一文教你Python如何快速精准抓取网页数据

本文将使用requests和beautifulsoup这两个流行的库来实现。1.准备工作首先安装必要的库:pipinst...

-

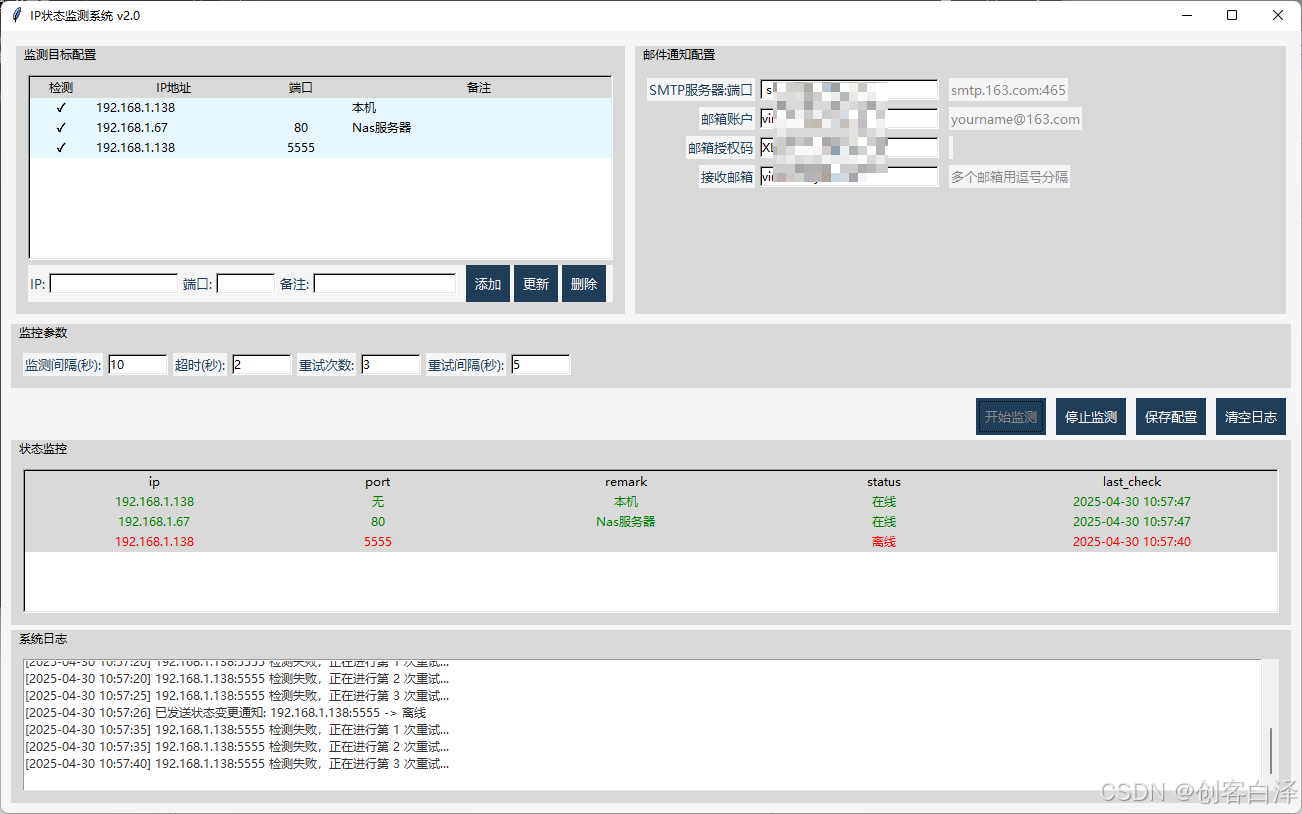

使用Python实现IP地址和端口状态检测与监控

-

基于Python打造一个智能单词管理神器

-

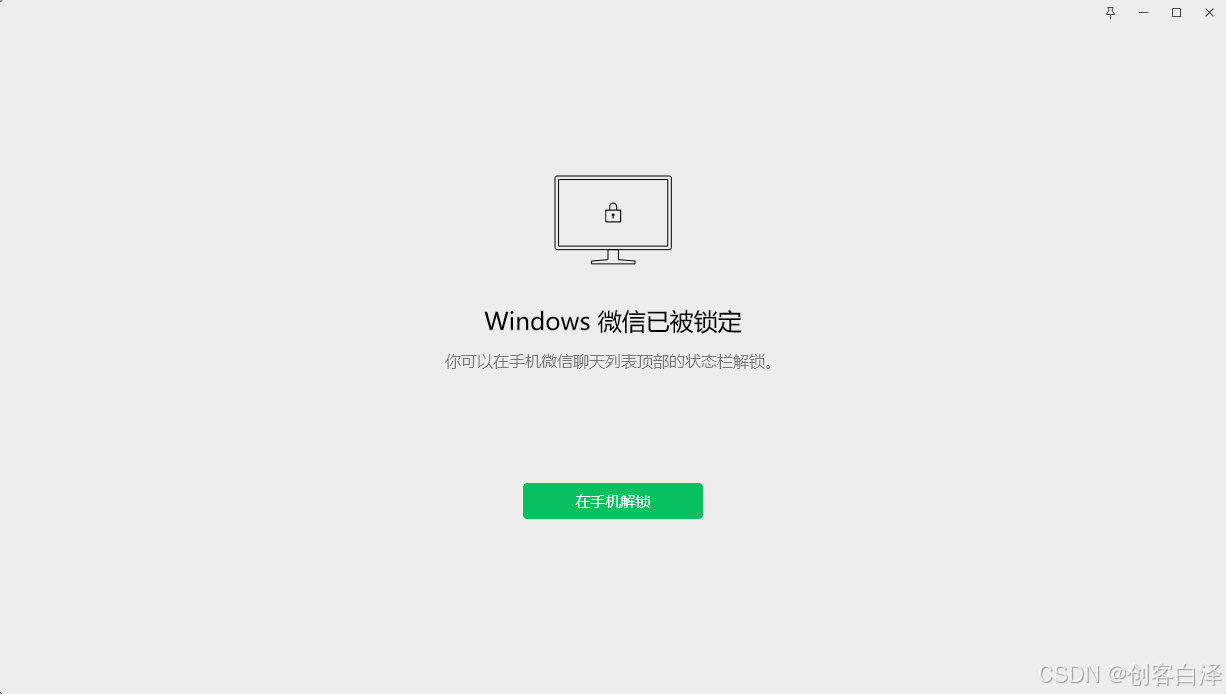

Python实现微信自动锁定工具

-

使用Python创建一个功能完整的Windows风格计算器程序

python实现windows系统计算器程序(含高级功能)下面我将介绍如何使用python创建一个功能完整的windows风格计...

-

Python开发文字版随机事件游戏的项目实例

随机事件游戏是一种通过生成不可预测的事件来增强游戏体验的类型。在这类游戏中,玩家必须应对随机发生的情况,这些情况可能会影响他们的资...

-

使用Pandas实现Excel中的数据透视表的项目实践

引言在数据分析中,数据透视表是一种非常强大的工具,它可以帮助我们快速汇总、分析和可视化大量数据。虽然excel提供了内置的数据透...

-

Pandas利用主表更新子表指定列小技巧

一、前言工作的小技巧,利用pandas读取主表和子表,利用主表的指定列,更新子表的指定列。案例:主表:uidname0...

-

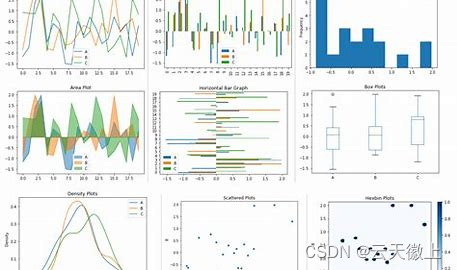

Pandas中统计汇总可视化函数plot()的使用

-

Python中tensorflow的argmax()函数的使用小结

在tensorflow中,argmax()函数是一个非常重要的操作,它用于返回给定张量(tensor)沿指定轴的最大值的索引。这个...