GitHub Copilot 伦理争议:AI 生成代码的版权与合规性问题

大家好,今天我想和大家聊聊一个非常热门的话题:GitHub Copilot 的伦理争议,特别是围绕 AI 生成代码的版权与合规性问题。随着人工智能技术的飞速发展,GitHub Copilot 这样的工具已经深入到开发者的日常工作中,但它也带来了许多值得我们深思的问题。

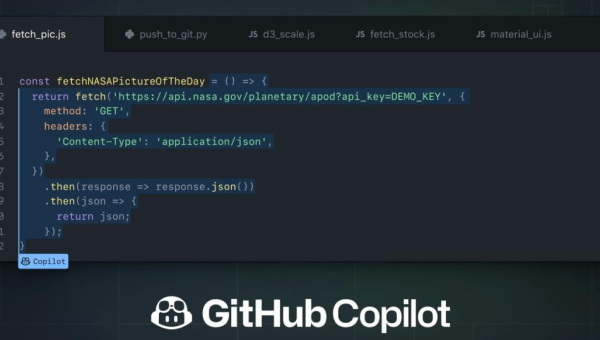

什么是 GitHub Copilot?

GitHub Copilot 是由 OpenAI 和 GitHub 联合开发的一款 AI 辅助编程工具。它能够根据开发者当前的代码上下文,提供代码建议、自动完成代码片段,甚至帮助解决复杂的编程问题。简单来说,它就像一个聪明的编程助手,能够极大地提高开发效率。

AI 生成代码的版权归属问题

GitHub Copilot 的出现,让代码生成变得更加轻松。但是,当 AI 生成的代码被用于实际项目时,版权归属问题就显得尤为重要。比如,如果 Copilot 生成了一段代码,这段代码的版权属于开发者,还是属于 OpenAI 或者 GitHub?目前,这个问题还没有一个明确的法律答案。

在法律上,版权通常归属于作品的创作者。然而,AI 生成的代码是否可以被视为“创作”?如果 Copilot 仅仅是在模仿已有的代码模式,那么它的输出可能并不具备独立的版权。但如果 Copilot 的生成结果具有高度的独创性,那么情况可能会变得复杂。

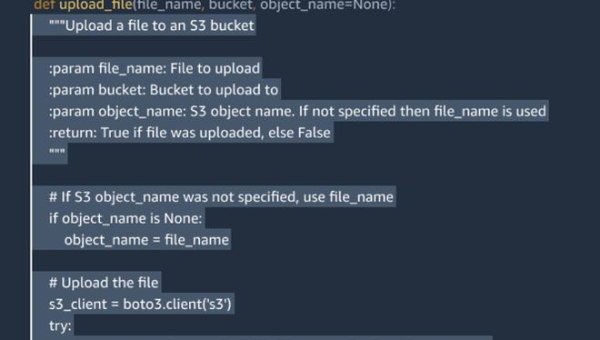

合规性问题:代码的来源与授权

另一个问题是代码的来源与授权。GitHub Copilot 的训练数据包括了大量的公开代码,这些代码可能来自开源项目或者其他受版权保护的资源。如果 Copilot 生成的代码中包含了这些数据中的片段,那么可能会引发版权纠纷。

例如,假设 Copilot 生成了一段与某个开源项目高度相似的代码,而这段代码被用于商业项目中,那么开源项目的作者可能会认为自己的版权受到了侵犯。因此,如何确保 AI 生成的代码不侵犯他人的版权,是一个亟待解决的问题。

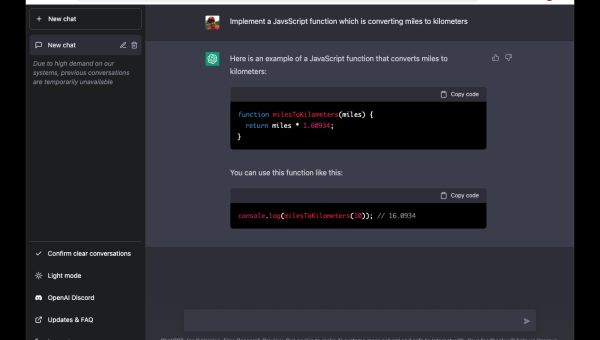

伦理争议:AI 是否应该拥有版权?

除了法律问题,GitHub Copilot 还引发了更深层次的伦理争议。AI 是否应该拥有版权?如果 AI 生成的代码被视为“创作”,那么 AI 是否应该享有与人类创作者相同的版权保护?这不仅涉及到法律层面,还涉及到对 AI 的定位和责任归属。

此外,AI 生成代码的透明性也是一个重要问题。开发者需要知道 Copilot 生成的代码是否基于合法的开源资源,或者是否存在潜在的版权风险。如果 Copilot 生成的代码中包含了未经授权的代码片段,那么开发者可能会面临法律风险。

未来的挑战与机遇

尽管 GitHub Copilot 带来了许多问题,但它也为我们提供了一个反思和改进的机会。未来,我们需要在法律、技术和伦理等多个层面共同努力,来解决这些问题。

首先,法律框架需要进一步完善。各国需要制定明确的法律条款,来界定 AI 生成内容的版权归属和使用规则。其次,技术层面也需要进步。例如,开发更加透明的 AI 模型,确保生成内容的来源可以被追溯和验证。

最后,伦理教育也至关重要。开发者需要了解 AI 生成代码的潜在风险,并在使用这些工具时保持警惕。只有通过多方的共同努力,才能让 AI 技术真正为人类的发展带来积极的影响。

总结

GitHub Copilot 的出现,无疑为开发者们带来了巨大的便利。然而,它也带来了版权与合规性等复杂的伦理问题。这些问题不仅需要法律和技术的支持,更需要我们每个人的思考和努力。希望未来,我们能够在享受 AI 带来便利的同时,也能妥善解决这些挑战,让技术真正服务于人类社会的发展。

推荐阅读

-

AI 代码工具未来:GitHub Copilot 与 Tabnine 的技术演进方向

-

AI 编程工具发展现状:GitHub Copilot 引发的代码生成范式变革

-

AI 辅助编程工具评测:如何利用 Copilot 提升代码质量与开发效率?

-

VS Code 2025 重大更新:AI 代码补全增强与远程开发体验升级

-

GitHub Copilot 伦理争议:AI 代码生成中的版权与代码安全问题

-

GitHub Copilot 代码生成:如何避免 AI 生成代码的安全隐患?

-

医疗人工智能技术是如何改善生活(人工智能、大数据如何服务医疗器械创新)

人工智能、大数据如何服务医疗器械创新?自动驾驶首先进入服务业,它的创新能力远超人类的想象人工智能后,人类该如何生存?大颠覆时代到来...

-

华人如何改变人工智能?以史为鉴能让我们更好地去伪存真

华人如何改变人工智能?以史为鉴能让我们更好地去伪存真,恰卡网带你了解更多相关信息。自1998年成立以来,微软亚研为中国...

-

准确率90%的AI机器人,是省事,还是添乱?

准确率90%的AI机器人,是省事,还是添乱?说到机器人和自动化,很多人脑里可能会立刻浮现一些生产线,比如汽车工厂的情景——一群机器...

-

如何实现人工智能AI猜你画的是什么

这篇文章主要介绍了如何实现人工智能AI猜你画的是什么,具有一定借鉴价值,感兴趣的朋友可以参考下,希望大家阅读完这篇文章之后大有收获...