怎么利用python3爬取漫画岛

怎么利用python3爬取漫画岛

这篇文章主要介绍“怎么利用python3爬取漫画岛”,在日常操作中,相信很多人在怎么利用python3爬取漫画岛问题上存在疑惑,小编查阅了各式资料,整理出简单好用的操作方法,希望对大家解答”怎么利用python3爬取漫画岛”的疑惑有所帮助!接下来,请跟着小编一起来学习吧!

一、效果展示

首先是我们想要爬取的漫画网页:http://www.manhuadao.cn/

网页截图:

其次是爬取下来的效果:

每一回的文件夹里面是这样的: (因为网站图片的问题...所以就成了这个鬼样子)

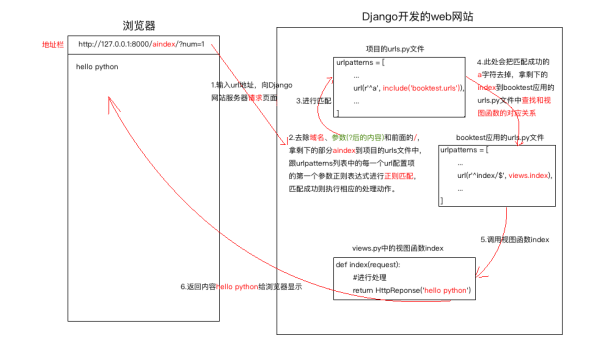

二、分析原理

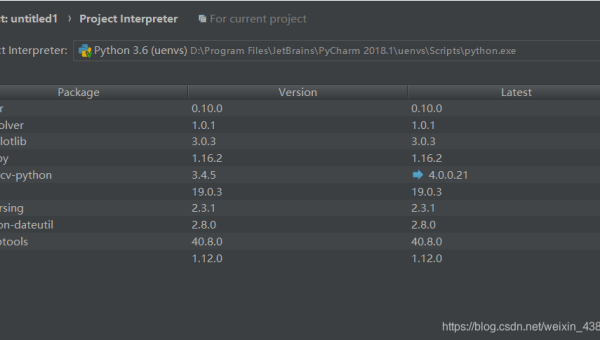

1、准备:需要vscode或者其他能够编译运行python的软件,推荐python版本3.X ,否则有可能出现编译问题。

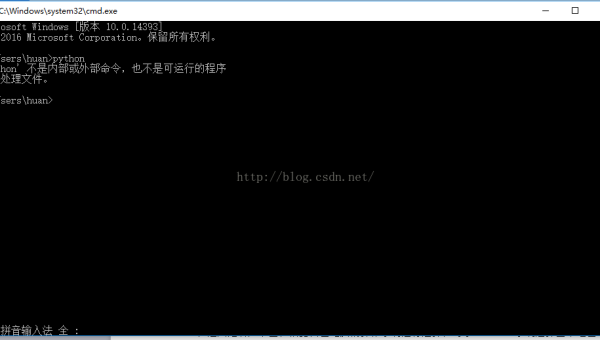

下载所需模块:win+R进入命令行,输入pipinstall <模块名>即可下载。例如:

pipinstallbeautifulsoup4

2、原理: 模拟浏览器点击->打开漫画网页链接->获取网页源码->定位每一章漫画的链接->模拟点击->获取图片页面源码->定位图片链接->下载图片

三、实际操作(代码附在最后)

1、引入模块 (这里不再详述)

2、模拟浏览器访问网页

(1)、这里我们打开漫画的目录页,如下: url = ”http://www.manhuadao.cn/Home/ComicDetail?id=58ddb07827a7c1392c234628“ ,此链接就是目录页链接。

(2)、按F12打开此网页的源码(谷歌浏览器),选中上方NetWork,Ctrl+R刷新。

(3)、找到加载网页的源码文件,点击Headers,如下图: StatusCode表示网页返回的代码,值为200时表示访问成功。

(4)、headers中的参数为下面红框User-Agent。

response=requests.get(url=url,headers=headers)#模拟访问网页print(response)#此处应输出

两个输出分别输出:

输出返回200表示访问成功。

(节选)

(5)、将html代码存入 data 中,xpath定位每一章链接。点击上方Element,点击:

将鼠标移至目录处:

右边代码区域出现每一章链接:

data=etree.HTML(response.text)#tp=data.xpath("//ul[@class="read-chapter"]/li/a[@class="active"]/@href")tp=data.xpath("//*[@class="yesReader"]/@href")zhang_list=tp#tp为链接列表

输出zhang_list,结果如下:

(6)、获取图片链接(获取方式同上一步)

点进第一章,同上一步,寻找到图片链接:

i=1fornext_zhanginzhang_list:#在章节列表中循环i=i+1j=0hui_url=r_url+next_zhangname1="第"+str(i)+"回"file="C:/Users/wangyueke/Desktop/"+keyword+"/{}/".format(name1)#创建文件夹ifnotos.path.exists(file):os.makedirs(file)print("创建文件夹:",file)response=requests.get(url=hui_url,headers=headers)#模拟访问每一章链接data=etree.HTML(response.text)#tp=data.xpath("//div[@class="no-pic"]//img/@src")tp=data.xpath("//div[@class="main-content"]//ul//li//div[@class="no-pic"]//img/@src")#定位ye_list=tp

(7)、下载图片

forkinye_list:#在每一章的图片链接列表中循环download_url=tp[j]print(download_url)j=j+1file_name="第"+str(j)+"页"response=requests.get(url=download_url)#模拟访问图片链接withopen(file+file_name+".jpg","wb")asf:f.write(response.content)

五、代码

"""用于爬取非人哉漫画目标网址:http://www.manhuadao.cn/开始时间:2019/8/1420:01:26完成时间:2019/8/1511:04:56作者:kong_gu"""importrequestsimportjsonimporttimeimportosfromlxmlimportetreefrombs4importBeautifulSoupdefmain():keyword="非人哉"file="E:/{}".format(keyword)ifnotos.path.exists(file):os.mkdir(file)print("创建文件夹:",file)r_url="http://www.manhuadao.cn/"url="http://www.manhuadao.cn/Home/ComicDetail?id=58ddb07827a7c1392c234628"headers={#模拟浏览器访问网页"User-Agent":"Mozilla/5.0(WindowsNT10.0;Win64;x64)AppleWebKit/537.36(KHTML,likeGecko)Chrome/75.0.3770.142Safari/537.36"}response=requests.get(url=url,headers=headers)#print(response.text)#输出网页源码data=etree.HTML(response.text)#tp=data.xpath("//ul[@class="read-chapter"]/li/a[@class="active"]/@href")tp=data.xpath("//*[@class="yesReader"]/@href")zhang_list=tpi=1fornext_zhanginzhang_list:i=i+1j=0hui_url=r_url+next_zhangname1="第"+str(i)+"回"file="C:/Users/wangyueke/Desktop/"+keyword+"/{}/".format(name1)#这里需要自己设置路径ifnotos.path.exists(file):os.makedirs(file)print("创建文件夹:",file)response=requests.get(url=hui_url,headers=headers)data=etree.HTML(response.text)#tp=data.xpath("//div[@class="no-pic"]//img/@src")tp=data.xpath("//div[@class="main-content"]//ul//li//div[@class="no-pic"]//img/@src")ye_list=tpforkinye_list:download_url=tp[j]print(download_url)j=j+1file_name="第"+str(j)+"页"response=requests.get(url=download_url)withopen(file+file_name+".jpg","wb")asf:f.write(response.content)if__name__=="__main__":main()

到此,关于“怎么利用python3爬取漫画岛”的学习就结束了,希望能够解决大家的疑惑。理论与实践的搭配能更好的帮助大家学习,快去试试吧!若想继续学习更多相关知识,请继续关注恰卡编程网网站,小编会继续努力为大家带来更多实用的文章!

推荐阅读

-

Python 3.12 新特性解析:模式匹配增强与性能优化实战

-

Lightly IDE 深度评测:轻量级 Python 开发工具是否适合团队协作?

-

VS Code 自定义配置:JSON 文件修改、代码片段与任务自动化脚本

-

Python 虚拟环境选择:venv、conda、poetry 的适用场景对比

-

PyCharm+GitHub Copilot:Python 开发中 AI 辅助编码的最佳实践

-

PyCharm 无法识别虚拟环境?5 步排查 Python 解释器配置问题

-

数据科学工具链:Jupyter Notebook+RStudio+Python 的协同工作流

-

Python 3.12 新特性:模式匹配增强与性能改进实战

-

Lightly IDE 适合谁?轻量级 Python 开发工具深度评测

-

Python IDE 终极对比:PyCharm vs VS Code vs Jupyter Notebook